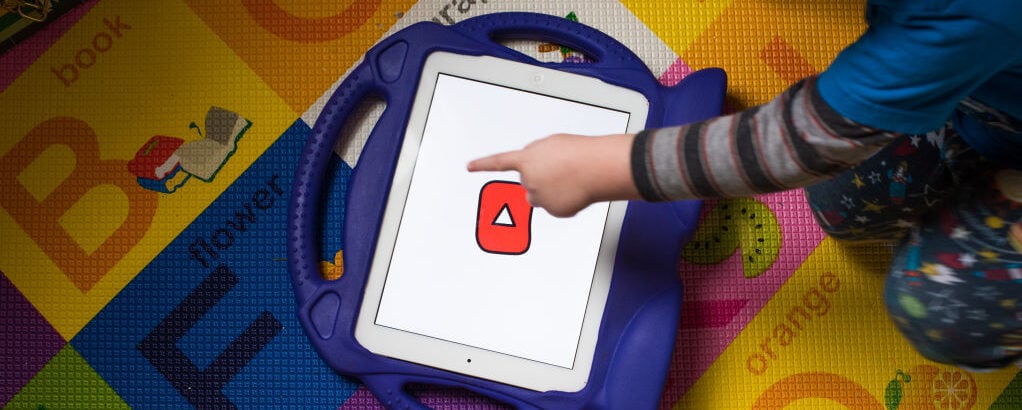

Cosa hanno in comune un cavallo che nasce da un uovo, un elefante rosa che cammina in equilibrio su una corda, del dentifricio che spreme animali glitterati e un rinoceronte che fa un tuffo olimpionico da un trampolino? Oltre a essere immagini grottesche, sono alcuni tra i contenuti presenti in migliaia di video su YouTube generati dall’Intelligenza artificiale e destinati ai bambini. Tutti i filmati durano meno di 30 secondi, non hanno alcun senso, cambiano scena continuamente e usano colori iper saturi, oltre a suoni acuti e ripetitivi.

La combinazione perfetta per generare dipendenza e divenire virali. Su YouTube, come sulle altre piattaforme, comanda infatti la legge dell’engagement: più un video trattiene l’attenzione di un utente, più viene raccomandato e maggiori sono i ricavi per il canale che lo propone. A questa logica rispondono anche i video per bambini. Ed è un grosso problema. Soprattutto se immagini come queste vengono presentate come “educative” (promettono di insegnare lettere, numeri o animali) e sono promossi in maniera massiccia dall’algoritmo del social.

Video AI per bambini: il vortice ipnotico che genera dipendenza

Il New York Times ha indagato a fondo il fenomeno: dopo aver guardato video di canali di cartoni animati per bambini popolari su YouTube, come CoComelon e Bluey, è iniziato il bombardamento con contenuti spazzatura, con oltre il 40% dei video suggeriti generato dall’Ia. Molti dei canali analizzati pubblicano più video al giorno grazie a strumenti come Runway o Google Whisk. I profili sono spesso anonimi, ma macinano milioni di visualizzazioni e ricavi pubblicitari attraverso il Programma partner di YouTube.

Il problema però non è solo che questi video sono scadenti e generano forte dipendenza. I bambini in età prescolare, infatti, hanno sistemi di attenzione ancora in formazione e video iperstimolanti producono sovraccarichi mentali, oltre a poter causare dissociazione cognitiva. Come sottolineato da Rachel Barr, psicologa dello sviluppo alla Georgetown University, l’accostamento tra elementi realistici e situazioni impossibili può creare confusione nei più piccoli, che faticano ancora a distinguere fantasia e realtà. I bambini infatti traggono maggior beneficio dalla visione di contenuti multimediali con una trama chiara, con un inizio, uno svolgimento e una fine, con personaggi nei quali è possibile identificarsi e scene riconducibili alla vita reale.

Rischi di ADHD e i limiti del Digital Services Act

I danni dell’iperstimolazione nei primi anni di vita possono inoltre trascinarsi a lungo. Diversi studi, tra cui una ricerca pubblicata su Jama Pediatrics nel 2019 da Jenny Radesky e colleghi, hanno documentato la correlazione tra esposizione precoce a media con editing rapido e difficoltà nel mantenimento dell’attenzione in età scolare. Una ricerca del Karolinska Institute in Svezia e dell’Oregon Health & Science University ha invece riscontrato un legame significativo tra il tempo trascorso davanti allo schermo e le diagnosi di Adhd.

Le risposte al problema da parte delle piattaforme social sono insufficienti, se non inesistenti. In seguito alla segnalazione del Nyt, YouTube ha sospeso cinque canali dal programma di monetizzazione, rimuovendoli da YouTube Kids. Alcuni video indicati dal giornale sono stati eliminati per violazione delle norme sulla sicurezza dei minori.

Tuttavia, l’obbligo di dichiarare se un video sia generato da Intelligenza artificiale riguarda solo contenuti realistici che possano essere scambiati per veri (come ad esempio i deepfake con volti o voci di persone reali) mentre per i cartoni animati per bambini non è richiesta un’etichettatura. Un paradosso che la normativa europea, in particolare il Digital Services Act (Dsa) non ha risolto. Il compito di filtrare ciò che guardano i bambini ricade interamente sui genitori, spesso però inesperti o distratti dalle incombenze quotidiane. D’altronde anche gli adulti, per non parlare degli adolescenti, son vittime del circolo vizioso dell’algoritmo. Basti pensare al colosso dei social per eccellenza, TikTok, finito nel mirino della Commissione europea con l’accusa di creare deliberatamente assuefazione tra gli utenti. I risultati preliminari dell’indagine di Bruxelles parlano infatti di induzione alla dipendenza grazie al sistema di scroll infinito, la riproduzione automatica dei video, le notifiche push e il sistema di raccomandazione altamente personalizzato, che possono portare a comportamenti compulsivi e ridurre l’autocontrollo degli utenti. Un meccanismo simile ai video in loop su YouTube. E una vera e propria droga. L’unica, però, a essere consumata sotto gli occhi di tutti anche da bambini di due anni.