La nuova frontiera della sicurezza digitale non passa più soltanto da una password, da un limite di tempo o da una spunta nelle impostazioni. Passa dall’età. O meglio, dalla capacità delle piattaforme di capire se chi sta usando un social ha davvero l’età che dichiara di avere. È su questo terreno, fragile e politicamente sensibile, che Meta annuncia un nuovo pacchetto di misure basate sull’intelligenza artificiale per rendere Instagram, Facebook e Messenger ambienti più sicuri e più adatti agli adolescenti.

Il punto è semplice solo in apparenza: per usare Instagram e Facebook bisogna avere almeno 13 anni. Nella realtà, però, la verifica dell’età online resta uno dei grandi buchi neri dell’intero ecosistema digitale. Un ragazzo può inserire una data di nascita falsa, presentarsi come adulto e aggirare protezioni pensate proprio per la sua fascia d’età. Da qui la decisione di Meta di rafforzare i propri sistemi di rilevamento, andando oltre l’autodichiarazione e utilizzando tecnologie capaci di analizzare segnali testuali, comportamentali e, per la prima volta in modo più avanzato, anche visivi.

La società annuncia infatti l’introduzione di sistemi di intelligenza artificiale in grado di analizzare testi, interazioni, post, commenti, bio, didascalie e contenuti dei profili per individuare account che potrebbero appartenere a minori di 13 anni. A questi strumenti si aggiunge l’analisi di foto e video, pensata per cogliere indizi che il testo da solo potrebbe non rivelare. Meta precisa che non si tratta di riconoscimento facciale: l’obiettivo non è identificare una persona specifica, ma stimare in modo approssimativo l’età sulla base di elementi generali, come altezza, struttura fisica o contesto visivo.

Account sospetti disattivati e verifica obbligatoria

Quando un account viene considerato sospetto, Meta procederà alla disattivazione. L’utente dovrà quindi dimostrare la propria età attraverso il processo di verifica previsto dalla piattaforma. In assenza di conferma, l’account potrà essere eliminato. L’azienda spiega inoltre di voler rafforzare i sistemi contro l’elusione delle regole, per impedire a utenti rimossi perché ritenuti troppo giovani di creare immediatamente nuovi profili.

È una svolta che fotografa il cambio di passo del settore: non basta più chiedere l’età, bisogna provare a verificarla. E farlo senza trasformare la tutela dei minori in un sistema invasivo, opaco o sproporzionato. Qui si gioca una partita delicatissima: protezione, privacy, autonomia degli adolescenti e responsabilità delle piattaforme devono convivere nello stesso spazio, senza che una dimensione divori completamente le altre.

Le protezioni per teenager arrivano anche nell’Unione Europea

Accanto al contrasto agli account degli under 13, Meta estende anche la tecnologia pensata per individuare gli account che potrebbero appartenere ad adolescenti, anche quando indicano una data di nascita da adulto, e inserirli automaticamente nelle protezioni degli account per teenager.

Questa tecnologia, già lanciata su Instagram negli Stati Uniti, in Australia, Canada e Regno Unito, viene ora estesa ai 27 Paesi dell’Unione Europea e al Brasile. Negli Stati Uniti è inoltre iniziata l’espansione su Facebook, con arrivo previsto in Europa e nel Regno Unito da giugno 2026.

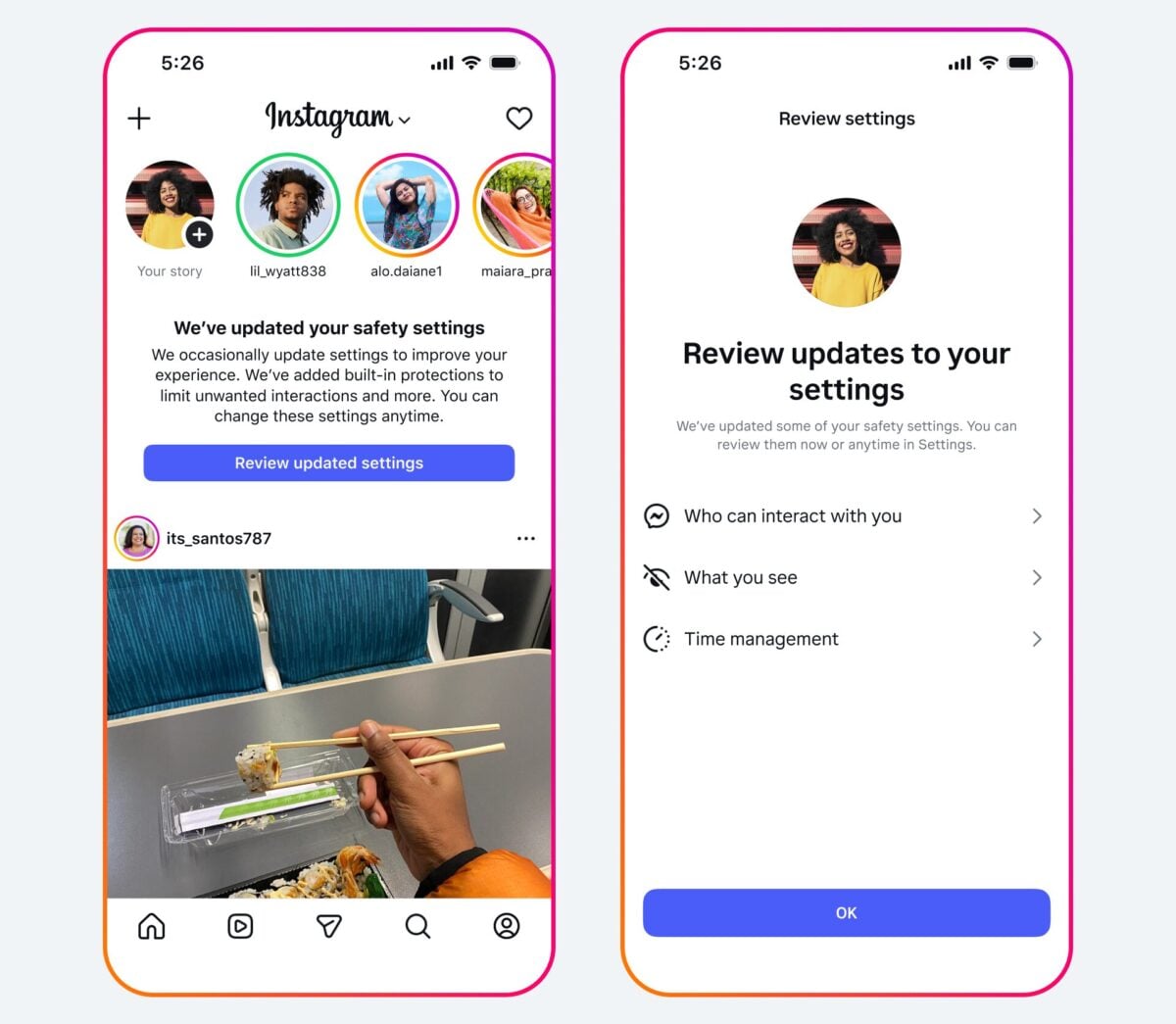

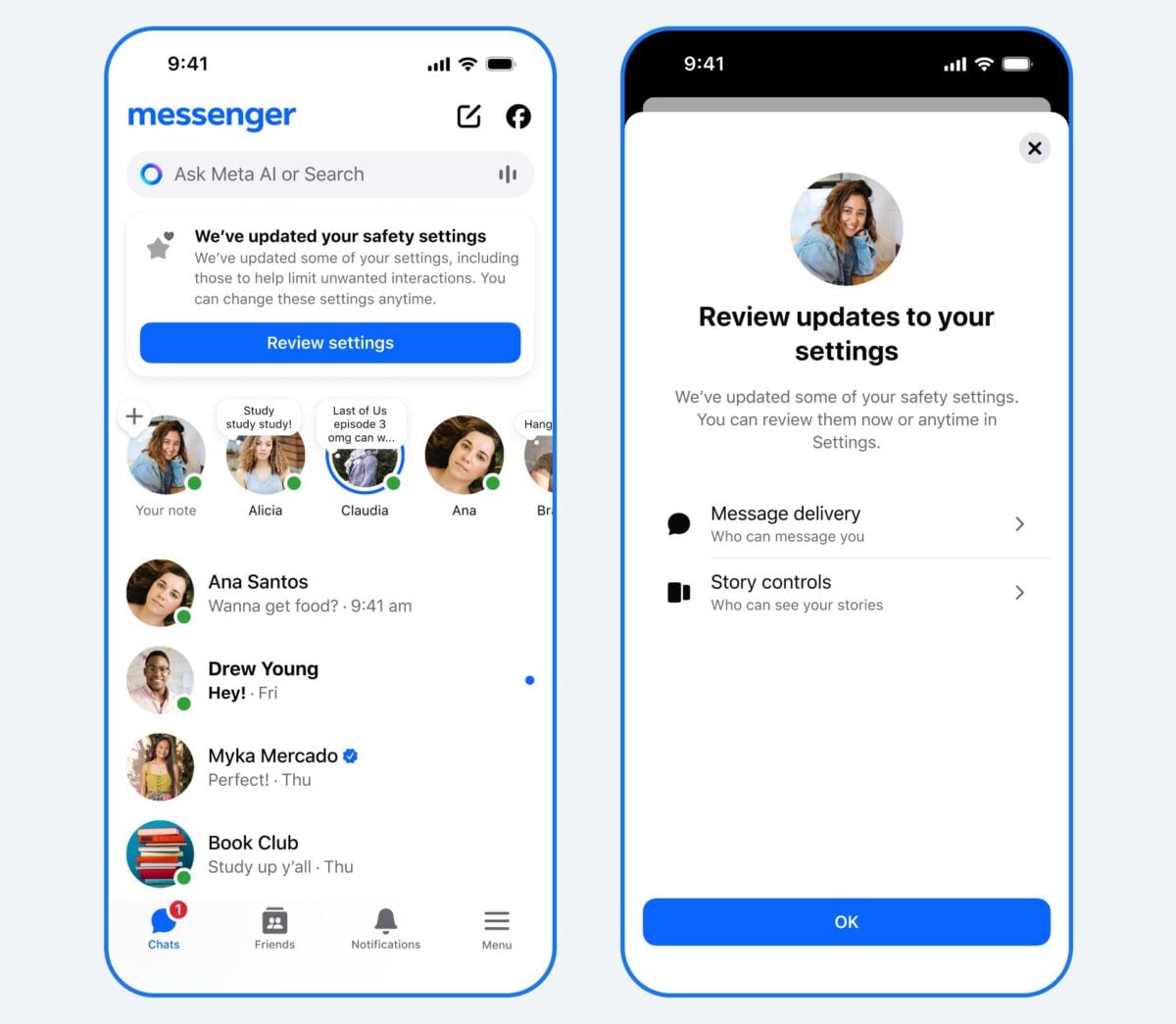

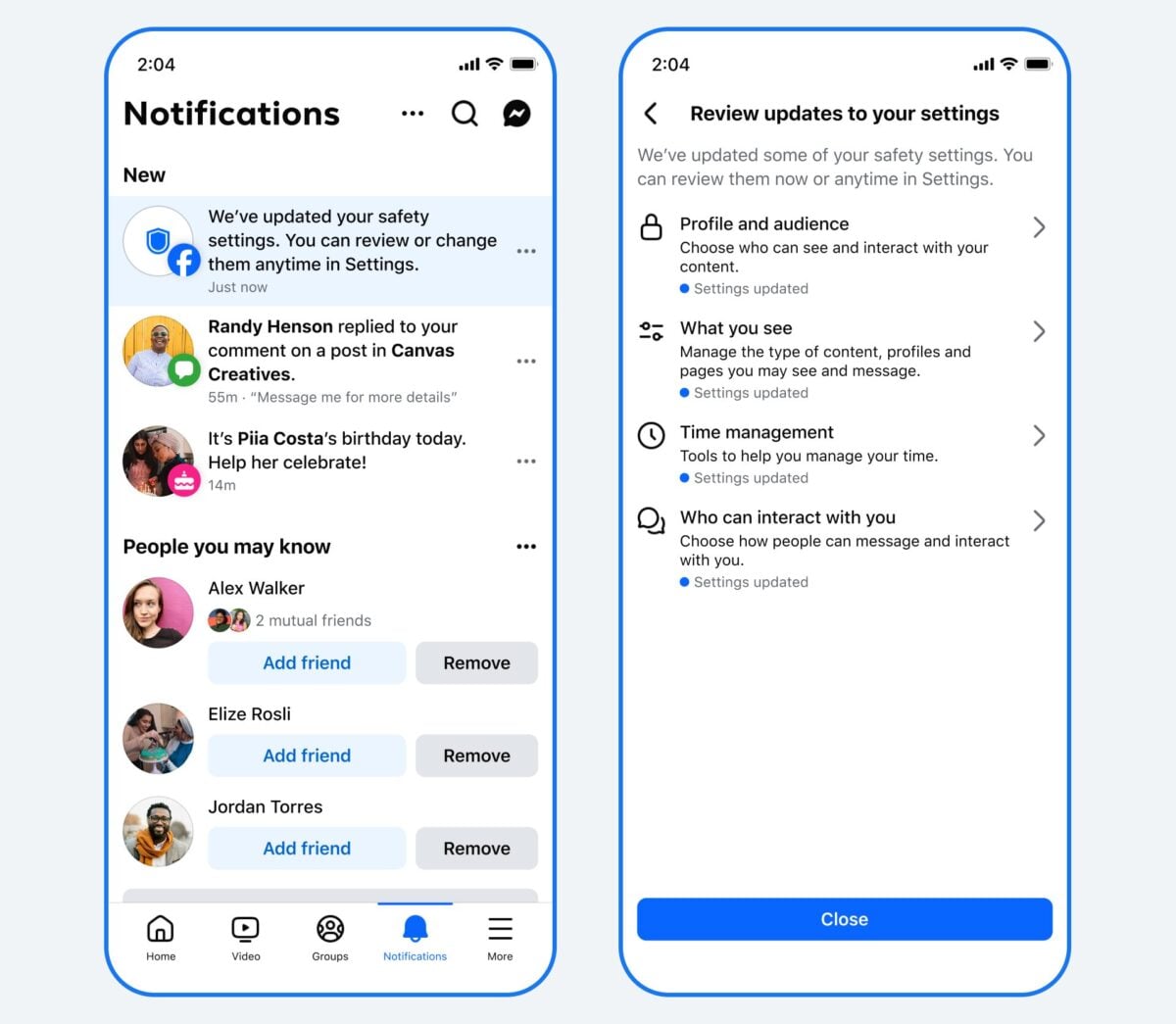

Gli account per teenager sono l’esperienza protetta che Meta ha costruito per i ragazzi tra i 13 e i 17 anni. Prevedono impostazioni restrittive attive di default, pensate per limitare chi può contattarli, quali contenuti possono vedere e con chi possono interagire. Nei materiali condivisi da Meta si ricorda che gli account degli adolescenti sono privati per impostazione predefinita, che i messaggi sono limitati alle persone che seguono o con cui sono già in contatto, che i contenuti sensibili vengono ridotti nei risultati di ricerca e nelle aree consigliate come Esplora, Reels e feed, e che tag e menzioni sono consentiti solo da parte delle persone seguite. Viene inoltre attivata automaticamente la versione più restrittiva della funzione anti-bullismo Parole Nascoste, insieme ai promemoria dopo 60 minuti di utilizzo quotidiano e alla modalità non disturbare tra le 22 e le 7.

Per i minori di 16 anni, inoltre, serve l’autorizzazione di un genitore per rendere meno restrittive alcune impostazioni attraverso la Supervisione genitori. Il messaggio è chiaro: non è più l’adolescente a dover cercare le protezioni, ma la piattaforma a doverle attivare prima.

La classificazione 13+ e i “contenuti limitati”

Dentro questo percorso si inserisce anche l’impostazione ispirata alla classificazione cinematografica 13+, introdotta per fare in modo che gli adolescenti vedano su Instagram contenuti coerenti con la propria fascia d’età. L’idea, nella formulazione di Meta, è che l’esperienza online di un teenager debba essere paragonabile a quella di un film adatto ai 13 anni: meno esposizione a contenuti sensibili, meno contenuti potenzialmente inappropriati, maggiore coerenza tra età dichiarata e ambiente digitale.

Per le famiglie che desiderano un livello di controllo ancora più alto, Meta ha introdotto anche l’impostazione “contenuti limitati”, una modalità più restrittiva che consente ai genitori di gestire in modo più puntuale l’esperienza dei propri figli.

Family Chat: la sicurezza non nasce solo dalla tecnologia

La parte più interessante del discorso, però, non è soltanto tecnica. È culturale. Meta lo ha ribadito anche con Family Chat, la campagna italiana presentata a Milano con la famiglia Caressa-Parodi e lo psicologo Luca Mazzucchelli: la sicurezza online degli adolescenti non si costruisce solo con strumenti digitali, filtri e impostazioni, ma anche attraverso il dialogo quotidiano in famiglia. L’iniziativa mette al centro l’idea che le oltre 50 funzionalità di sicurezza introdotte da Meta raggiungano la loro piena efficacia quando entrano in un contesto di fiducia reciproca tra genitori e figli.

È un passaggio decisivo, perché sposta la conversazione fuori dalla solita trincea tra controllo totale e libertà assoluta. Gli adolescenti non vivono il digitale come un mondo separato. Per loro social, chat, scuola, amicizie, insicurezze e identità personale sono parte dello stesso ecosistema. Le paure espresse online spesso riflettono quelle vissute nella quotidianità. Gli interessi, le relazioni, le fragilità e i comportamenti che appaiono sui social raramente nascono soltanto lì: sono il prolungamento di quello che succede in famiglia, in classe, nel gruppo degli amici, nella vita reale.

Per questo Meta insiste sul concetto di accompagnamento. La tecnologia può ridurre i rischi, ma non può sostituire la relazione educativa. Un filtro può bloccare un contenuto, ma non spiega a un ragazzo perché quel contenuto lo attira, lo inquieta o lo fa sentire inadeguato. Una notifica può avvisare un genitore, ma non costruisce automaticamente una conversazione. Una piattaforma può chiudere una porta, ma serve ancora qualcuno che aiuti un adolescente a capire da quale porta non entrare.

Genitori più coinvolti, anche nelle conversazioni con l’intelligenza artificiale

Tra le novità richiamate nei materiali Meta c’è anche un nuovo strumento legato alle conversazioni degli adolescenti con Meta AI. I genitori che utilizzano la supervisione potranno vedere gli argomenti di cui i figli hanno parlato con l’intelligenza artificiale negli ultimi sette giorni, senza trasformare questo controllo in una lettura integrale e invasiva delle conversazioni. L’obiettivo dichiarato è offrire spunti utili per aprire un dialogo sulle esperienze dei ragazzi con l’IA.

Meta ha inoltre presentato un AI Wellbeing Expert Council, un gruppo di esperti chiamato a contribuire allo sviluppo di esperienze con l’intelligenza artificiale più sicure e adeguate all’età degli adolescenti. È un terreno nuovo e potenzialmente enorme: dopo anni di discussione sui social, la prossima partita sarà infatti il rapporto tra minori e chatbot, tra risposte automatiche, confidenze digitali, contenuti generati e nuove forme di dipendenza emotiva dalla tecnologia.

Le notifiche sui segnali di disagio

Il sistema di protezione si allarga anche ai segnali di sofferenza. Meta ha annunciato che Instagram inizierà a inviare notifiche ai genitori quando i figli adolescenti cercheranno ripetutamente, in un breve arco di tempo, termini legati a suicidio o autolesionismo. Gli avvisi saranno accompagnati da risorse sviluppate con il contributo di esperti, pensate per aiutare gli adulti ad affrontare conversazioni particolarmente delicate.

Anche qui il confine è sottile. Da una parte c’è l’esigenza evidente di non lasciare soli i ragazzi davanti a segnali di disagio. Dall’altra c’è la necessità di evitare che la sorveglianza digitale diventi l’unico strumento con cui una famiglia intercetta il malessere. L’utilità di questi avvisi dipenderà molto dalla capacità degli adulti di trasformarli in ascolto e non in interrogatorio, in presenza e non in panico.

WhatsApp e i preadolescenti: account gestiti dai genitori

Nei materiali allegati compare anche un’altra novità significativa: gli account WhatsApp gestiti dai genitori per i preadolescenti sotto i 13 anni. Annunciati l’11 marzo, questi account consentono a genitori o tutori di configurare WhatsApp per i figli più piccoli, con controlli pensati per limitare l’esperienza a messaggi e chiamate.

Gli account devono essere creati e gestiti attivamente dagli adulti, restano collegati al loro account WhatsApp e permettono ai genitori di controllare chi può contattare i figli, a quali gruppi possono accedere e quali impostazioni sulla privacy vengono applicate. È una risposta a un dato ormai evidente: molti bambini entrano nella messaggistica prima ancora di arrivare ai social, e spesso lo fanno in una zona grigia, attraverso smartphone di famiglia, gruppi scolastici, chat sportive o comunità informali.

Benessere digitale, sicurezza e sextortion

Il pacchetto Meta non riguarda solo l’età, ma anche il benessere digitale e la protezione da comportamenti abusivi. Tra gli strumenti già disponibili ci sono il limite giornaliero, la modalità non disturbare, il reset dei contenuti suggeriti, il controllo della sicurezza, l’autenticazione a due fattori e la funzione Parole Nascoste, che permette di filtrare commenti e richieste di messaggi contenenti parole offensive, truffe o contenuti indesiderati.

Particolare attenzione viene dedicata anche al contrasto alla sextortion e alla diffusione non consensuale di immagini intime. Instagram prevede strumenti come la protezione dalle immagini di nudo, che sfoca automaticamente contenuti potenzialmente espliciti ricevuti nei messaggi e mostra avvisi sia a chi riceve sia a chi invia o tenta di inoltrare immagini sensibili. Meta ricorda inoltre il proprio sostegno a iniziative come StopNCII, Take It Down e Lantern, il programma globale della Tech Coalition che consente alle aziende tecnologiche di condividere segnali su account e comportamenti legati a violazioni della sicurezza dei minori.

La richiesta di una maggiore età digitale europea

C’è infine il capitolo politico. Meta ribadisce la richiesta di una legislazione che imponga agli app store di verificare l’età degli utenti e ottenere il consenso dei genitori per il download delle app da parte dei minori. La società sostiene da tempo l’introduzione di una maggiore età digitale condivisa a livello europeo, basata non sul divieto generalizzato, ma sull’approvazione dei genitori a livello di app store o sistema operativo.

La logica è quella della coerenza: secondo Meta, le regole non dovrebbero valere solo per i social network, ma per tutti i servizi digitali usati dagli adolescenti. Il punto, nella visione dell’azienda, è costruire un meccanismo semplice, rispettoso della privacy e uniforme in tutta l’Unione Europea, evitando che ogni piattaforma debba inventare da sola un sistema diverso di verifica dell’età.

Una nuova fase per il rapporto tra adolescenti e piattaforme

La direzione è ormai chiara. I social non possono più essere trattati come spazi neutri, dove la responsabilità viene scaricata interamente sull’utente, tanto meno quando l’utente è minorenne. Meta prova a costruire un modello più stratificato: intelligenza artificiale per individuare gli account sospetti, protezioni automatiche per i teenager, notifiche ai genitori, strumenti contro contenuti sensibili e comportamenti abusivi, campagne educative e richiesta di regole comuni a livello legislativo.

Resta aperta la domanda più importante: quanto controllo è necessario per proteggere un adolescente senza trasformare la sua esperienza digitale in una stanza sorvegliata? La risposta non può essere soltanto tecnica. Deve passare dalle piattaforme, certo, ma anche dalle famiglie, dalla scuola, dalle istituzioni e da un’educazione digitale finalmente adulta.

Perché il punto non è più stabilire se i ragazzi vivano online. Lo fanno già. Il punto è decidere se lasciarli attraversare quel mondo da soli, con una data di nascita falsa e un algoritmo davanti, oppure costruire attorno a loro un sistema meno ingenuo, meno permissivo e finalmente più responsabile.