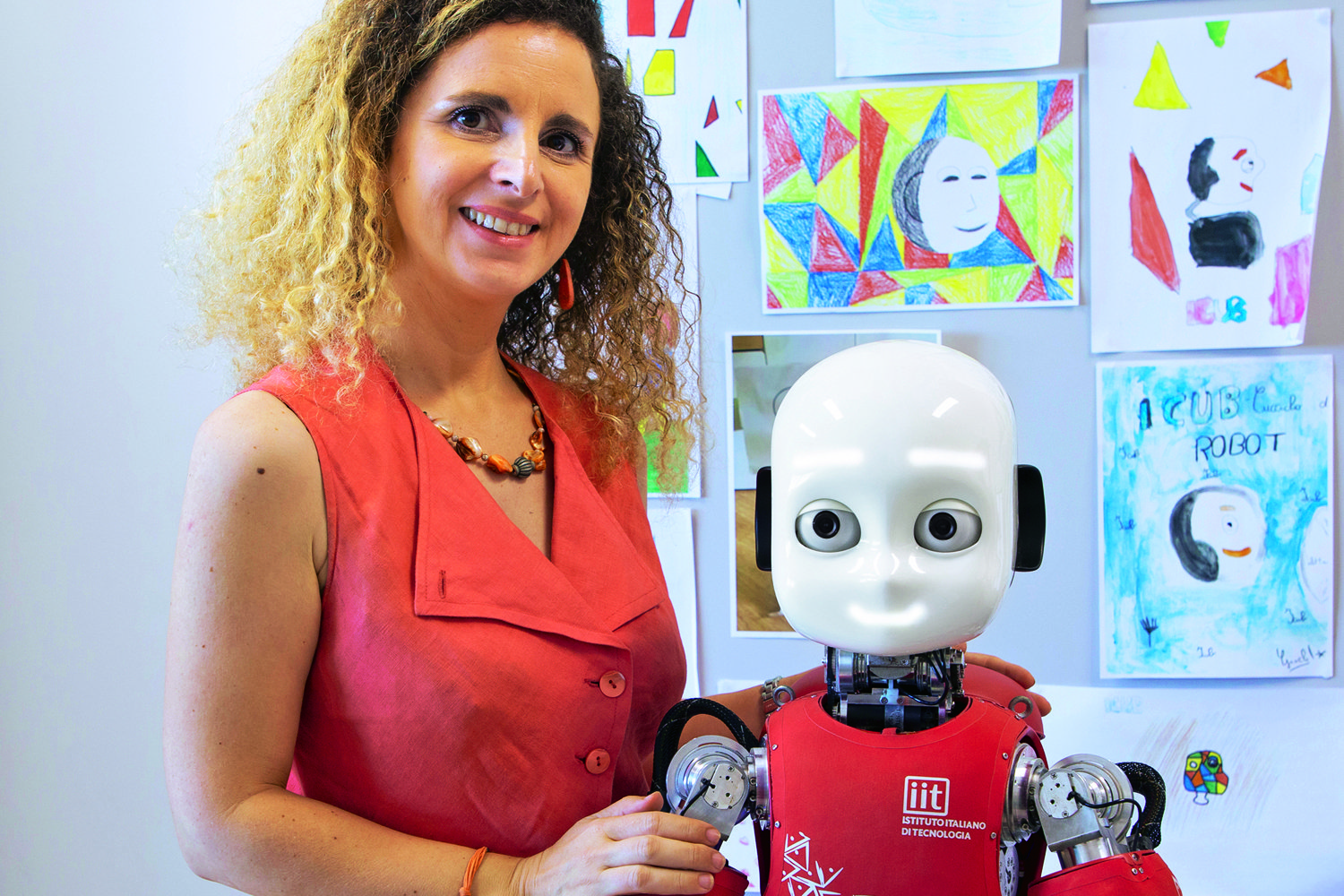

Insegnare agli automi a «capire» i nostri stati d’animo (compresi ansia, fretta, nervosismo) e persino a giocare a carte con un pizzico di rivalità. È quello che fa Alessandra Sciutti, neuroingegnere all’Istituto Italiano di Tecnologia di Genova. Il suo studente più bravo, il piccolo iCub.

Uscite di casa di corsa agitatissimi e in forte ritardo, senza aver fatto nemmeno colazione, e l’applicazione della vostra compagnia ferroviaria non funziona. Chiamate il call center per capire almeno da quale binario partirà il treno. «Buongiorno, sono l’operatore 36 delle Ferrovie italiane, il treno 9946 è previsto al binario 15 fra 26 minuti. Avete anche il tempo di prendere un caffè alla caffetteria sul lato opposto al binario». Sarà probabilmente così, in futuro, il dialogo tra noi e un operatore «robotico» che capisce, intuisce il nostro stato d’animo e modula il suo «feedback». E anziché innervosirci come facciamo adesso quando abbiamo a che fare con «sono la tua assistente virtuale», volenterosa ma ottusa, chiuderemo la telefonata finalmente soddisfatti. A raccontarlo a Panorama è Alessandra Sciutti, 41 anni, genovese, neuroingegnere e grande esperta di robotica cognitiva, che lavora all’Istituto italiano di tecnologia (Iit) di Genova.

«Guardando le tecnologie disponibili, oggi ci sono macchine molto avanzate cui mancano però due competenze fondamentali per interagire con noi: la predizione, cioè la capacità di prevedere un’azione; e l’intuizione» spiega Sciutti. Ciò che gli automi devono ancora imparare dagli esseri umani, in sostanza, è interagire con loro. E Sciuti sta insegnando proprio questo al robottino iCub, «nato» all’Iit nel 2004. Il piccolo umanoide ha le sembianze accattivanti di un bimbo di tre anni: alto 104 centimetri, 22 chilogrammi, ricoperto di pelle in quasi tutto il corpo, possiede 53 gradi di libertà di movimento e 53 motori, muove la testa, gli arti inferiori e quelli superiori, è in grado di afferrare degli oggetti (gli mancano solo gusto e olfatto). Nel 2018 Sciutti ha vinto uno «starting grant», un finanziamento di 1,7 milioni di euro dell’European research council (Erc), per il progetto wHiSPER (www.whisperproject.eu), il cui obiettivo è far sì che i robot «vedano» ciò che li circonda attraverso i nostri occhi, e stabilire una percezione condivisa tra uomo e macchina.

Un robot che sia consapevole di come noi percepiamo il mondo e le azioni altrui, di che cosa attira la nostra attenzione e cosa invece potrebbe sfuggirci, potrà più facilmente collaborare con noi, anche aiutandoci a non commettere errori. Con questi fondi Sciutti ha potuto avviare l’unità Contact (Cognitive architecture for collaborative technologies): una squadra di una trentina di esperti fra ingegneri, informatici, scienziati cognitivi, psicologi, filosofi e neurofisiologi. Questo sforzo collettivo di rendere gli automi il più possibile simili a noi, capaci di veri e propri dialoghi, parte da lontano, più precisamente dal progetto europeo multidisciplinare Robotcub, iniziato nel 2004 e durato 65 mesi: una piattaforma aperta (open source) dalla quale è «nato» proprio iCub.

«Una delle domande che si erano posti gli scienziati coinvolti» spiega Sciutti «è come nell’infanzia s’impara a prevedere le azioni di un’altra persona. Dallo studio è emerso che per un bambino è importante saper compiere un’azione prima di riuscire a capirne lo scopo. Ossia, prima viene l’azione, ed è questo che permette a noi umani di collaborare in maniera efficace gli uni con gli altri. I modelli su come funziona una parte della nostra intelligenza vengono poi riprodotti sul robot». La ricercatrice cita alcuni esempi di robotica cognitiva realizzati da Contact, nell’ambito del progetto wHiSPER. «Si dice che gli occhi siano lo specchio dell’anima, che ci si intende con un’occhiata. Ecco, insegnando a iCub a seguire il nostro sguardo, lui può comprenderci senza ulteriori istruzioni. Lo abbiamo verificato in un test in cui doveva passare uno dei due oggetti che aveva in mano: è stato in grado di capire quale oggetto passare e quando semplicemente “leggendo” la direzione dello sguardo».

Ma quali sono i metodi di allenamento applicati ad iCub? «Il primo è il “model based”, derivato dall’essere umano e copiato direttamente sul robot. Per far sollevare all’automa un oggetto in maniera differente in funzione del suo peso, come una bottiglia vuota o piena. In questo caso studiamo come cambia la velocità quando lo facciamo noi, copiamo il modello sul robot che così solleverà gli oggetti allo stesso modo e con la stessa nostra velocità». Molto di questo lavoro di ricerca è basato sul machine learning (meccanismo per cui i computer apprendono dai dati e migliorano con l’esperienza). «Insegniamo a identificare le espressioni facciali, a fare una stima approssimativa dello stato emotivo. Un altro esempio: iCub impara a riconoscere se un oggetto è fragile o no guardando come una persona lo sta manipolando e spostando».

E poi, c’è il «reinforcement learning», l’apprendimento potenziato. «Lo abbiamo utilizzato per fare partecipare iCub a un gioco di carte. L’obiettivo è inserire negli automi anche meccanismi psicologici come la rivalità, componente importante nell’essere umano e in genere poco considerata nell’A.I. Il nostro robottino ha così rivelato strategie diverse, più simili a quelle degli umani». In altre parole, «quando giochiamo a carte spesso nasce una forma di rivalità nei confronti di qualcuno tra gli altri concorrenti. Da quel momento, miriamo non soltanto a vincere ma anche ad assicurarci che il nostro rivale perda. Per esempio, scegliamo di passare una mano, invece di scartare, per evitare che le carte da noi scartate possano fornire al rivale un’occasione di fare punti. Sono questi meccanismi a rendere avvincente una partita. Abbiamo verificato che si può allenare un robot a fare qualcosa di simile, ossia a giocare tenendo conto della rivalità, così che la sua strategia non sia solo guidata dall’obiettivo di vincere, ma anche di far perdere un avversario».

Una capacità che potrà essere trasferita ad altri automi, macchine, computer. Degli obiettivi di wHiSPER Sciutti ha parlato anche all’Internet festival di Pisa il 6 ottobre scorso. «Se sto cercando di prendere un ascensore di corsa mentre si chiudono le porte, una macchina in genere aspetta un’istruzione, non si avventura in un’azione per fermare le porte. Perché appunto il robot non è predittivo. Ed è questa la nostra sfida: renderlo tale. E poi c’è l’importanza dell’intuizione, del non detto. La mia massima ambizione» conclude la ricercatrice «è arrivare un giorno in laboratorio e vedere iCub indicarmi il libro che cercavo il giorno prima, magari sorridendo».